摘要

盡管運動恢複結構(SfM)作為(wei) 一種成熟的技術已經在許多應用中得到了廣泛的應用,但現有的SfM算法在某些情況下仍然不夠魯棒。例如,比如圖像通常在近距離拍攝以獲得詳細的紋理才能更好的重建場景細節,這將導致圖像之間的重疊較少,從(cong) 而降低估計運動的精度。在本文中,我們(men) 提出了一種激光雷達增強的SfM流程,這種聯合處理來自激光雷達和立體(ti) 相機的數據,以估計傳(chuan) 感器的運動。結果表明,在大尺度環境下,加入激光雷達有助於(yu) 有效地剔除虛假匹配圖像,並顯著提高模型的一致性。在不同的環境下進行了實驗,測試了該算法的性能,並與(yu) 最新的SfM算法進行了比較。

CMU Smith Hall重建點雲(yun) 模型(灰色),覆蓋視覺特征點(紅色)

相關(guan) 工作與(yu) 主要貢獻

基於(yu) 機器人的檢測需求越來越大,需要對橋梁、建築物等大型土木工程設施的高分辨率圖像數據進行處理。這些應用通常使用高分辨率、寬視場(FOV)相機,相機在離結構表麵近距離處拍攝,以獲得更豐(feng) 富的視覺細節。這些特性對標準SfM算法提出了新的挑戰。首先,大多數可用的全局或增量SfM方案都是基於(yu) 單個(ge) 攝像機的,因此不能直接恢複比例。更重要的是,由於(yu) 視場的限製,相鄰圖像之間的重疊區域被縮小,從(cong) 而導致姿態圖隻能局部連通,從(cong) 而影響運動估計的精度。這個(ge) 問題在大規模環境中變得更加重要。

為(wei) 了解決(jue) 上述挑戰本文提出了一種新的方案,它擴展了傳(chuan) 統的SfM算法,使之適用於(yu) 立體(ti) 相機和LiDAR傳(chuan) 感器。這項工作基於(yu) 一個(ge) 簡單的想法,即激光雷達的遠距離能力可以用來抑製圖像之間的相對運動。更具體(ti) 地說,我們(men) 首先實現了一個(ge) 立體(ti) 視覺SfM方案,它計算攝像機的運動並估計視覺特征(結構)的三維位置。然後將激光雷達點雲(yun) 和視覺特征融合到一個(ge) 單一的優(you) 化函數中,迭代求解該優(you) 化函數以最優(you) 化相機的運動和結構。在我們(men) 的方案中,LiDAR數據從(cong) 兩(liang) 個(ge) 方麵增強了SfM算法:

1)LiDAR點雲(yun) 用於(yu) 檢測和排除無效的圖像匹配,使基於(yu) 立體(ti) 相機的SfM方案對視覺模糊具有更強的魯棒性;

2)LiDAR點雲(yun) 與(yu) 視覺特征在聯合優(you) 化框架中相結合,以減少運動漂移。我們(men) 的方案可以實現比最先進的SfM算法更一致和更精確的運動估計。

本文的工作主要有以下幾個(ge) 方麵:

1)將全局SfM技術應用於(yu) 立體(ti) 攝像係統,實現了攝像機在真實尺度下的運動初始化。

2) 激光雷達數據被用來排除無效的圖像匹配,進一步加強了方案的可靠性。

3) 通過聯合立體(ti) 相機和激光雷達的共同的數據,擴展了我們(men) 先前提出的聯合優(you) 化方案,提高了所建模型的精度和一致性。

激光雷達增強的雙目SFM

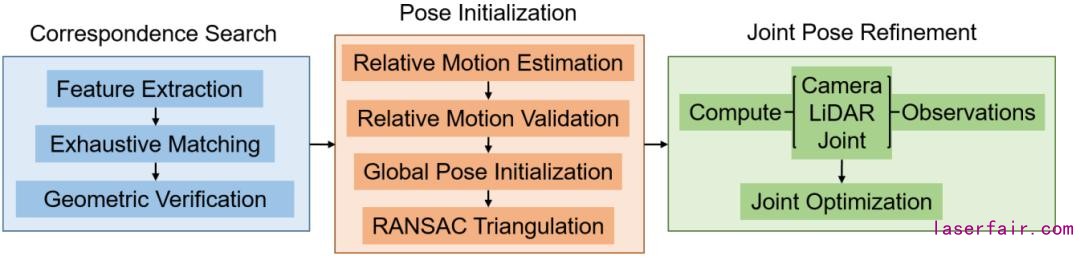

該方案以一組立體(ti) 圖像和相關(guan) 的LiDAR點雲(yun) 作為(wei) 輸入,以三角化特征點和合並的LiDAR點雲(yun) 的格式生成覆蓋環境的三維模型。下圖顯示了我們(men) 的LiDAR增強SfM方案的過程 光雷達增強的雙目SFM方案

光雷達增強的雙目SFM方案

A、 對應特征點搜索

給定立體(ti) 圖像對,計算對應關(guan) 係包括特征提取、匹配和幾何驗證。首先,我們(men) 依賴OpenMVG庫從(cong) 圖像中提取SIFT特征。然後使用所提供的級聯哈希方法對特征進行窮盡匹配。最後,通過對雙目極線約束進行幾何的驗證,驗證了兩(liang) 幅圖像之間的匹配。具體(ti) 地說,利用RANSAC估計基本矩陣F,然後用來檢查匹配特征的極線誤差。隻保留幾何上一致的特征,以便進一步計算。

B、 相對運動估計

由於(yu) 立體(ti) 圖像對是預先校準的,所以我們(men) 將一對左右圖像作為(wei) 一個(ge) 獨立的單元,為(wei) 了估計相對運動,標準的立體(ti) 匹配方法依賴於(yu) 兩(liang) 對圖像中所有四幅圖像所觀察到的特征點,而我們(men) 觀察到許多點隻被三幅甚至兩(liang) 幅圖像共享。忽略這些點可能會(hui) 丟(diu) 失估計相機運動的重要信息,特別是在圖像重疊有限的情況下。因此,這裏選擇顯式地處理兩(liang) 個(ge) 位姿點之間共享視圖的不同情況。具體(ti) 來說,我們(men) 考慮至少3個(ge) 視圖共享的特征點,以確保尺度的重建。雖然隻有2個(ge) 視圖的點可以幫助估計旋轉和平移方向,但是由於(yu) 這些點通常來自於(yu) 下圖所示的小重疊區域,所以這裏忽略它們(men) 。另一方麵,兩(liang) 個(ge) 位姿點之間也可能存在多種類型的共享特性。為(wei) 了簡化問題,我們(men) 選擇對應關(guan) 係最多的類型來求解相對運動。在三視圖情況下,首先用立體(ti) 圖像對,對特征點點進行三角化,然後用RANSAC+P3P算法求解。在四視圖的情況下,我們(men) 遵循標準的處理方法,首先對兩(liang) 個(ge) 站點中的點進行三角化,然後應用RANSAC+PCA配準算法找到相對運動。在這兩(liang) 種情況下,都使用非線性優(you) 化程序來優(you) 化計算的姿態和三角化,通過最小化內(nei) 線的重投影誤差。最後,對所有姿態進行變換以表示左攝像機之間的相對運動。

兩(liang) 視圖要素的區域示例。左:一位姿右圖像;中右:另一位姿的左右圖像。共同的小區域靠近邊界並用紅框標記。

兩(liang) 個(ge) 位姿點(紅色和藍色圓圈對)之間共享特征(灰點)的示例。彩色條表示已知的校準後的立體(ti) 圖像對。(a)-(d)三視圖;(e)四視圖。

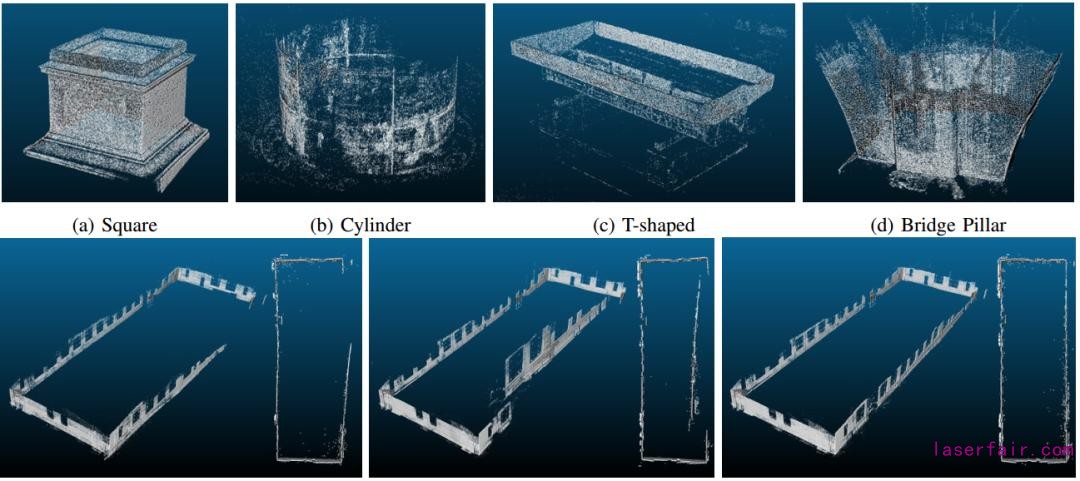

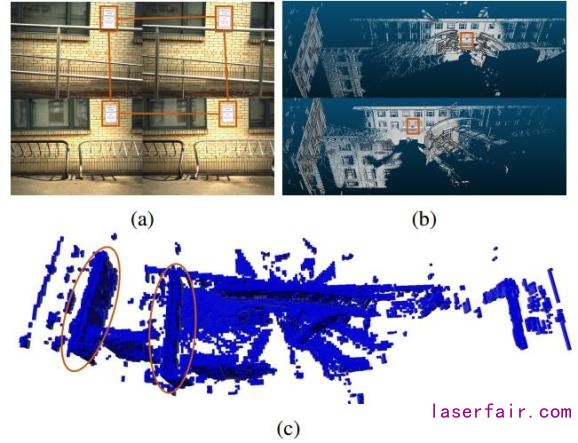

C、 相對運動驗證

一旦找到了相對運動,就可以建立一個(ge) 姿態圖,其中節點表示圖像幀的姿態,邊表示相對運動。全局姿態可以通過平均位姿圖上的相對運動來求解。然而,由於(yu) 環境中的視覺模糊性(見下圖),可能存在無效的邊緣,並且直接平均相對運動可能會(hui) 產(chan) 生不正確的全局姿勢。因此,設計了一個(ge) 兩(liang) 步邊緣驗證方案來去除異常值。

(1)在第一步中,檢查所有圖像幀對的激光雷達點雲(yun) 的重疊,並剔除不一致的點雲(yun) 。

(2)第二步中檢查回環的一致性。(具體(ti) 方法可在論文中有詳細說明)

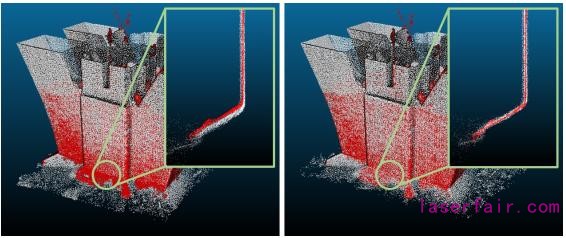

由於(yu) 視覺模糊導致的無效相對運動的例子。(a) 由於(yu) 相同的停車標誌,兩(liang) 對圖像匹配不正確。(b) 相應的點雲(yun) 來自兩(liang) 個(ge) 車站,標誌用紅框標出。(c) 合並的占用網格顯示不正確的對齊方式(紅色橢圓)。在這種情況下,一致性比為(wei) 0.56,而有效相對運動的一致性比通常超過0.7

D、 全局位姿初始化

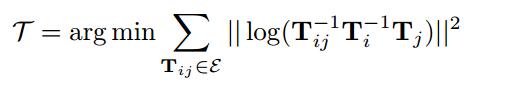

這部分主要介紹優(you) 化全局幀的代價(jia) 函數:

E、三角化與(yu) RANSAC

本文采用文魯棒三角化方法,對每個(ge) 三維特征點使用RANSAC來尋找最佳的三角化視圖。對於(yu) 每個(ge) 軌跡,它是不同相機視圖中一個(ge) 特征點的觀察值的集合,隨機對兩(liang) 個(ge) 視圖進行采樣,並使用DLT方法對該點進行三角化。通過將該點投影到其他視圖上並選擇具有較小重投影誤差的視圖,可以找到更匹配的視圖。此過程重複多次,並保留最大的一組內(nei) 部視圖(至少需要3個(ge) 視圖)。最後,通過最小化重投影誤差,利用內(nei) 聯視圖優(you) 化特征點在全局結構中的位姿。

F、聯合位姿優(you) 化

基於(yu) 視覺的SfM算法的位姿優(you) 化通常通過束調整(BA)來實現。然而,由於(yu) 多個(ge) 係統原因,如特征位置不準確、標定不準確、對應異常值等,位姿估計在長距離內(nei) 可能會(hui) 產(chan) 生較大的漂移,尤其是在無法有效地發現閉合環路的情況下。為(wei) 了解決(jue) 這個(ge) 問題,我們(men) 考慮利用激光雷達的遠距離能力來限製相機的運動,該方案將相機機和激光雷達觀測值聯合最優(you) 化。這部分內(nei) 容可查看原文理解公式。

實驗結果

A、實驗裝置

下圖具有多個(ge) 機載傳(chuan) 感器,包括兩(liang) 個(ge) Ximea彩色攝像頭(1200萬(wan) 像素,全局快門)和一個(ge) 安裝在連續旋轉電機上的Velodyne Puck激光雷達(VLP-16)。利用編碼器測量的電機角度,將VLP-16的掃描點轉換成固定的基架。

傳(chuan) 感器盒子和數據集

B、 相對運動估計

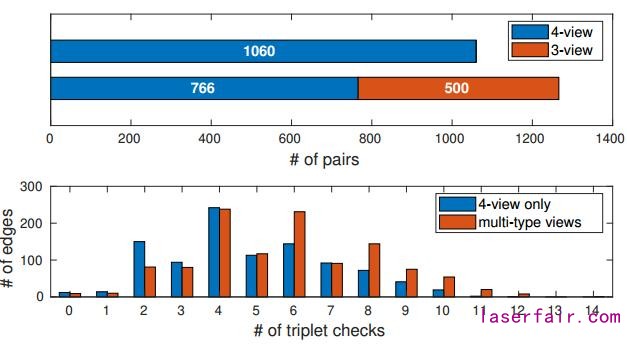

上圖:從(cong) 4個(ge) 視圖和3個(ge) 視圖點顯示求解的對數。下圖:不同三元組檢查的邊數直方圖。

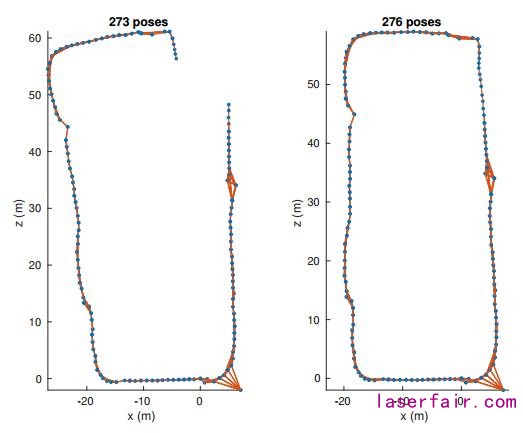

左圖:初始化的位姿圖有4個(ge) 視圖特征。右:使用多視圖初始化位姿圖

C、 相對運動驗證

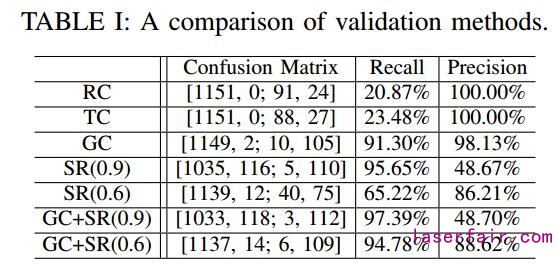

這裏比較了所提出的基於(yu) 網格的檢查(GC,閾值為(wei) 0.6)和成功率檢查(SR)與(yu) OpenMVG使用的旋轉循環檢查和transform(旋轉和平移)循環檢查(TC)的異常值排除法的性能。

D、 聯合測量

這裏展示聯合觀測建模在聯合優(you) 化中的優(you) 勢。如下圖所示

激光雷達點雲(yun) (灰色)與(yu) 重建視覺特征(紅色)疊加。左:沒有聯合觀測。右:聯合觀測。

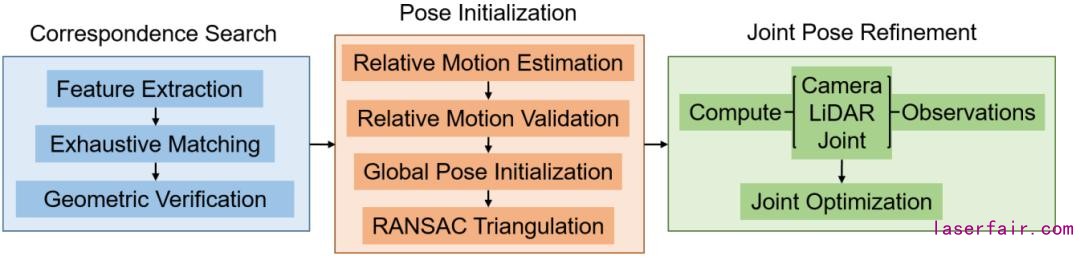

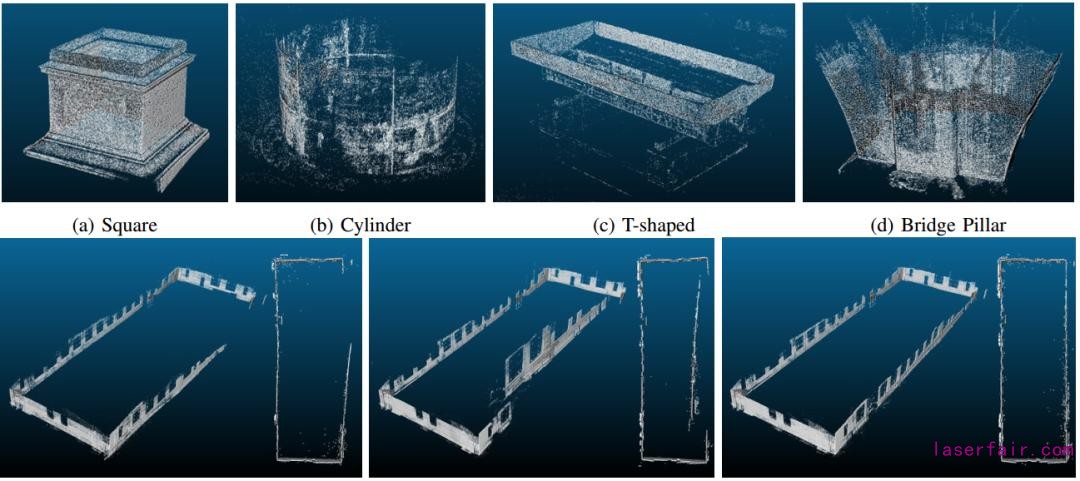

E、重建

對收集到的數據集的重建結果下圖所示。在第一行,展示了小型混凝土結構的重建。第二行比較了使用COLMAP、OpenMVG和我們(men) 的方案Smith-Hall重建結果。在這三個(ge) 測試中,使用左右圖像進行重建。然而,COLMAP和OpenMVG都無法處理由停車標誌,和有限的重疊圖像造成的視覺模糊。因此,生成的模型要麽(me) 不一致,要麽(me) 不完整。使用我們(men) 的方案有助於(yu) 有效地排除無效的運動,並允許建立一個(ge) 更一致的模型。

重建的結果對比

總 結

本文提出了一種利用激光雷達信息提高立體(ti) SfM方案的魯棒性、準確性、一致性和完備性的LiDAR增強立體(ti) SfM方案。實驗結果表明,該方法能有效地找到有效的運動位姿,消除視覺模糊。此外,實驗結果還表明,結合相機和激光雷達的聯合觀測有助於(yu) 完全約束外部變換。最後,與(yu) 最先進的SfM方法相比,LiDAR增強SfM方案可以產(chan) 生更一致的重建結果。

轉載請注明出處。

相關文章

相關文章

熱門資訊

熱門資訊

精彩導讀

精彩導讀

關注我們

關注我們